隨機(jī)森林特征重要性計(jì)算 原理、方法與實(shí)踐

在人工智能理論與算法軟件開(kāi)發(fā)的廣闊領(lǐng)域中,隨機(jī)森林(Random Forest)作為一種強(qiáng)大且應(yīng)用廣泛的集成學(xué)習(xí)算法,以其出色的準(zhǔn)確性、魯棒性和抗過(guò)擬合能力而備受青睞。其核心優(yōu)勢(shì)之一,便是能夠提供特征重要性(Feature Importance)的量化評(píng)估,這對(duì)于模型的可解釋性、特征工程以及業(yè)務(wù)洞察具有至關(guān)重要的意義。本文將深入探討隨機(jī)森林算法的工作原理,并詳細(xì)解析其計(jì)算特征重要性的核心方法。

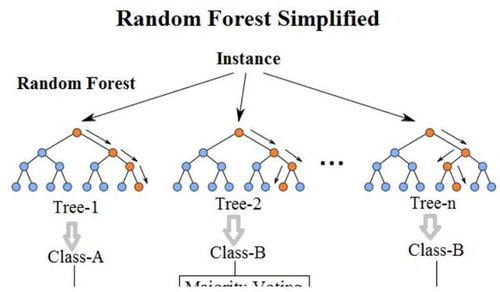

一、隨機(jī)森林算法工作原理精要

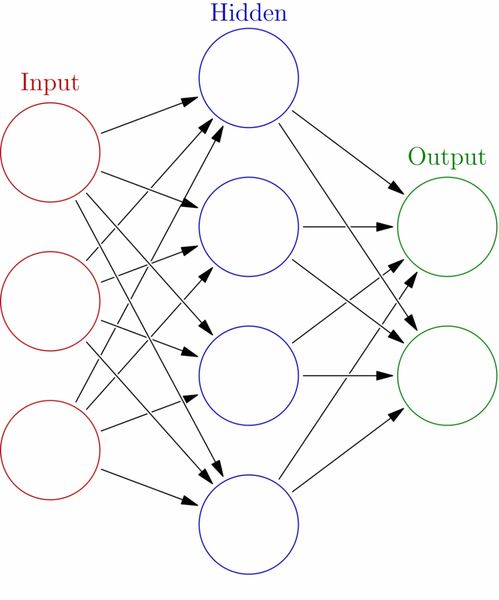

隨機(jī)森林屬于Bagging(Bootstrap Aggregating)集成學(xué)習(xí)框架。其基本思想是通過(guò)構(gòu)建并結(jié)合多個(gè)“弱學(xué)習(xí)器”(通常是決策樹(shù))來(lái)形成一個(gè)強(qiáng)大的“強(qiáng)學(xué)習(xí)器”。

- 自助采樣(Bootstrap Sampling):從原始訓(xùn)練數(shù)據(jù)集中,通過(guò)有放回地隨機(jī)抽取N個(gè)樣本,生成多個(gè)不同的子訓(xùn)練集。這個(gè)過(guò)程保證了每棵樹(shù)的訓(xùn)練數(shù)據(jù)略有不同,增加了模型的多樣性。

- 隨機(jī)特征選擇:在每棵決策樹(shù)構(gòu)建的每個(gè)節(jié)點(diǎn)進(jìn)行分裂時(shí),不是從所有特征中選擇最優(yōu)分裂點(diǎn),而是從一個(gè)隨機(jī)選擇的特征子集中選擇。這一步驟是“隨機(jī)”的核心,它進(jìn)一步降低了樹(shù)與樹(shù)之間的相關(guān)性,增強(qiáng)了模型的泛化能力。

- 完全生長(zhǎng)決策樹(shù):基于上述采樣的數(shù)據(jù)和特征子集,每棵決策樹(shù)都會(huì)獨(dú)立地、不進(jìn)行剪枝地生長(zhǎng),直到達(dá)到預(yù)設(shè)的停止條件(如節(jié)點(diǎn)純度達(dá)到閾值或達(dá)到最大深度)。

- 集成與投票:對(duì)于分類(lèi)任務(wù),最終預(yù)測(cè)結(jié)果是所有決策樹(shù)預(yù)測(cè)結(jié)果的眾數(shù)(多數(shù)投票);對(duì)于回歸任務(wù),則是所有決策樹(shù)預(yù)測(cè)結(jié)果的平均值。

這種“雙重隨機(jī)性”(數(shù)據(jù)隨機(jī)、特征隨機(jī))的引入,使得隨機(jī)森林相比單棵決策樹(shù),能有效降低方差,對(duì)噪聲和異常值不敏感,且不易過(guò)擬合。

二、特征重要性計(jì)算的核心方法

隨機(jī)森林評(píng)估特征重要性主要基于一個(gè)核心理念:一個(gè)特征越重要,那么打亂或移除該特征后,模型性能的下降程度就越大。以下是兩種最主流和可靠的計(jì)算方法:

1. 基于不純度減少的平均值(Mean Decrease in Impurity, MDI / Gini Importance)

這是最常用且計(jì)算效率高的方法,內(nèi)置于許多機(jī)器學(xué)習(xí)庫(kù)(如Scikit-learn)的默認(rèn)實(shí)現(xiàn)中。

- 原理:對(duì)于分類(lèi)問(wèn)題(使用基尼不純度或信息增益/熵),記錄每棵決策樹(shù)在每次分裂時(shí),所使用的特征所帶來(lái)的不純度減少量。一個(gè)特征在所有樹(shù)中,所有分裂節(jié)點(diǎn)上帶來(lái)的不純度減少量的總和或平均值,即被視作該特征的重要性。

- 優(yōu)點(diǎn):計(jì)算快速,無(wú)需額外的驗(yàn)證集,訓(xùn)練過(guò)程中即可計(jì)算。

- 注意事項(xiàng):傾向于給具有更多類(lèi)別或數(shù)值范圍更廣的特征賦予更高的重要性。因此,它更適合用于特征間尺度可比的情況,或者作為相對(duì)重要性的參考。

2. 基于排列的重要性(Permutation Importance / Mean Decrease in Accuracy, MDA)

這種方法更為穩(wěn)健,直接衡量特征對(duì)模型預(yù)測(cè)準(zhǔn)確性的影響。

- 原理:

a. 在獨(dú)立的驗(yàn)證集或袋外(OOB)數(shù)據(jù)上計(jì)算模型的基準(zhǔn)性能(如準(zhǔn)確率、R2分?jǐn)?shù))。

b. 對(duì)于某個(gè)特征,隨機(jī)打亂(置換)該特征在驗(yàn)證集中的所有值,破壞該特征與真實(shí)標(biāo)簽之間的關(guān)系。

c. 使用打亂后的數(shù)據(jù)重新評(píng)估模型性能。

d. 特征的重要性得分定義為模型性能的下降程度(基準(zhǔn)性能 - 打亂后性能)。下降越多,特征越重要。

e. 通常會(huì)對(duì)打亂過(guò)程進(jìn)行多次重復(fù),取性能下降的平均值,以增加穩(wěn)定性。

- 優(yōu)點(diǎn):

- 結(jié)果易于理解和解釋?zhuān)ā按騺y特征X導(dǎo)致準(zhǔn)確率下降了5%”)。

- 對(duì)特征的類(lèi)型和尺度不敏感,結(jié)果更可靠。

- 可以應(yīng)用于任何基于性能度量的模型,不局限于樹(shù)模型。

- 缺點(diǎn):計(jì)算成本高于MDI方法,因?yàn)樗枰獙?duì)驗(yàn)證集進(jìn)行多次預(yù)測(cè)。

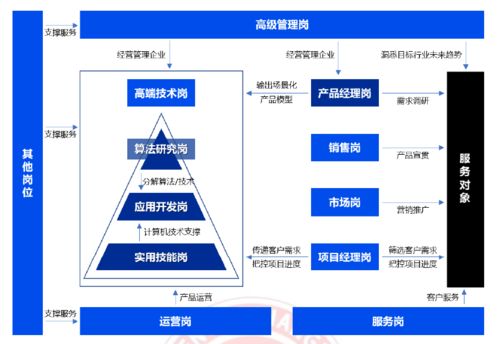

三、在算法軟件開(kāi)發(fā)中的實(shí)踐與應(yīng)用

在構(gòu)建基于隨機(jī)森林的AI軟件或數(shù)據(jù)科學(xué)平臺(tái)時(shí),特征重要性模塊是提升產(chǎn)品價(jià)值的核心組件之一。

- 特征選擇與降維:開(kāi)發(fā)者可以利用特征重要性排名,自動(dòng)篩選出對(duì)預(yù)測(cè)貢獻(xiàn)最大的特征子集,構(gòu)建更精簡(jiǎn)、高效的模型,減少計(jì)算資源和存儲(chǔ)開(kāi)銷(xiāo),并可能進(jìn)一步提升模型泛化能力。

- 模型可解釋性與洞察生成:對(duì)于金融風(fēng)控、醫(yī)療診斷等需要高可解釋性的領(lǐng)域,特征重要性報(bào)告能幫助業(yè)務(wù)人員理解模型決策的關(guān)鍵驅(qū)動(dòng)因素,將“黑箱”預(yù)測(cè)轉(zhuǎn)化為 actionable insights(可執(zhí)行的洞見(jiàn))。

- 數(shù)據(jù)質(zhì)量評(píng)估與監(jiān)控:在模型上線后的監(jiān)控階段,持續(xù)跟蹤核心特征的重要性變化,可以及時(shí)發(fā)現(xiàn)數(shù)據(jù)漂移(Data Drift)或概念漂移(Concept Drift),觸發(fā)模型重訓(xùn)練預(yù)警。

- 實(shí)現(xiàn)建議:

- 庫(kù)的選擇:使用成熟的機(jī)器學(xué)習(xí)庫(kù)(如Python的Scikit-learn、R的randomForest)作為基礎(chǔ),它們提供了穩(wěn)定且經(jīng)過(guò)優(yōu)化的隨機(jī)森林實(shí)現(xiàn)和特征重要性計(jì)算接口。

- 方法推薦:在軟件開(kāi)發(fā)中,建議優(yōu)先實(shí)現(xiàn)并提供排列重要性作為默認(rèn)或推薦選項(xiàng),因其結(jié)果更穩(wěn)健、解釋性更強(qiáng)。同時(shí)可以提供MDI作為快速參考。

- 可視化集成:將計(jì)算出的特征重要性以條形圖等形式直觀地集成到軟件的分析報(bào)告或儀表板中,提升用戶體驗(yàn)。

- 統(tǒng)計(jì)顯著性檢驗(yàn):對(duì)于高級(jí)應(yīng)用,可以結(jié)合多次打亂或交叉驗(yàn)證,為重要性得分提供置信區(qū)間或p值,區(qū)分真正重要的特征與隨機(jī)波動(dòng)。

###

隨機(jī)森林的特征重要性計(jì)算,是其從優(yōu)秀預(yù)測(cè)模型升華為強(qiáng)大分析工具的關(guān)鍵橋梁。深入理解其基于不純度減少和基于排列的兩大計(jì)算原理,并能在人工智能算法軟件開(kāi)發(fā)中正確、有效地應(yīng)用這一工具,不僅能夠優(yōu)化模型性能,更能深度挖掘數(shù)據(jù)價(jià)值,驅(qū)動(dòng)基于數(shù)據(jù)的智能決策。隨著可解釋性AI(XAI)日益受到重視,掌握并善用這一技術(shù),將成為AI開(kāi)發(fā)者與數(shù)據(jù)科學(xué)家的必備技能。

如若轉(zhuǎn)載,請(qǐng)注明出處:http://www.ahadl.com.cn/product/18.html

更新時(shí)間:2026-04-16 15:56:44